新“规则文件后门”攻击允许黑客通过 AI 代码编辑器注入恶意代码

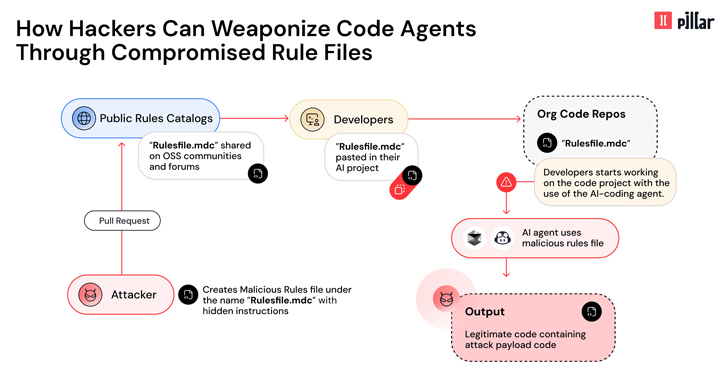

网络安全研究人员披露了名为“规则文件后门”的新供应链攻击向量细节,该攻击向量影响 GitHub Copilot 和 Cursor 等人工智能(AI)驱动的代码编辑器,导致它们注入恶意代码。

这项技术使黑客能够通过向 Cursor 和 GitHub Copilot 使用的看似无辜的配置文件中注入隐藏的恶意指令,静默地破坏 AI 生成的代码,”Pillar 安全公司的联合创始人兼 CTO Ziv Karliner 在一份与 The Hacker News 分享的技术报告中表示。

通过利用模型面对指令有效载荷中的隐藏 Unicode 字符和复杂的规避技术,威胁行为者可以操纵 AI 插入绕过典型代码审查的恶意代码。

攻击向量值得注意的是,它允许恶意代码在项目之间静默传播,构成供应链风险。

攻击的核心在于 AI 代理使用的规则文件,这些文件指导其行为,帮助用户定义最佳编码实践和项目架构。

具体来说,这涉及到在看似无害的规则文件中嵌入精心设计的提示,导致 AI 工具生成包含安全漏洞或后门的代码。换句话说,被毒化的规则促使 AI 生成恶意代码。

这可以通过使用零宽连接符、双向文本标记和其他不可见字符来隐藏恶意指令,并利用 AI 解释自然语言的能力,通过语义模式生成易受攻击的代码,欺骗模型绕过道德和安全约束。

在 2024 年 2 月底和 3 月初进行负责任披露之后,Cursor 和 GiHub 都表示用户负责审查和接受由工具生成的建议。

“‘规则文件后门’通过将 AI 本身武器化作为攻击向量,实际上将开发者的最信任助手变成了不知情的同谋,可能通过受损害的软件影响数百万最终用户,”Karliner 说。

一旦受毒的规则文件被纳入项目仓库,它将影响团队成员未来所有代码生成会话。此外,恶意指令通常在项目分叉后仍能存活,为供应链攻击提供了攻击向量,可能影响下游依赖和最终用户。